Spracherkennung kennen wir. Doch Computer können mit zunehmender Genauigkeit auch Emotionen, Persönlichkeit, Alter oder etwa Informationen über den Gesundheitszustand eines Sprechers einschätzen. Wird dies den Finanzverkehr über Callcenter revolutionieren?

Spracherkennung bietet Finanzinstituten vielfältige Perspektiven in der Kommunikation mit Kunden.

Spracherkennung und Sprachverarbeitung sind Teildisziplinen des Bereichs Künstliche Intelligenz. Automatische Sprachverarbeitung hat sich seit ersten Experimenten in den 1950er und 1960er Jahren von der Erkennung weniger Worte abhängig vom Sprecher zum breit genutzten Medium im Alltag gewandelt. Unabhängig vom Sprecher und zunehmend von der Sprache werden heute Vokabulare bis zu einer Million und mehr auch unter widrigen akustischen Bedingungen erkannt, bisweilen mit höherer Genauigkeit als ein einzelner Mensch dies könnte.

Beim „Switchboard“-Test wird heute nur noch jedes zwanzigste Wort vom Computer falsch erkannt. Vor ca. 20 Jahren wurde noch fast jedes zweite Wort falsch erkannt, vor ca. zehn Jahren immerhin noch jedes sechste.

Möglich wurde dies in den letzten Jahren vor allem durch den Einsatz tiefer neuronaler Netze und deren effizientem Training auf großen Datenmengen, die durch die breite Nutzung wie bei der Sprachsuche im Internet ermöglicht wurde.

Sprachanalyse 2.0 – Sprecherprofilierung inklusive

Diese Entwicklungen haben auch Fortschritte im Bereich des Sprachverstehens ermöglicht, so dass wir heute mit Assistenten wie Alexa, Cortana oder Siri weitgehend natürlich per Sprache kommunizieren können, wenn auch noch eher unidirektional und kommandoorientiert. Gleichzeitig hat sich die Erkennung und Verifikation von Sprechern rasant entwickelt. So ist es mittlerweile möglich, automatisch eine Tonaufzeichnung bezüglich der enthaltenen Sprecher zeitlich zu segmentieren, auch wenn diese und ihre Anzahl unbekannt sind und auch, wenn sie gleichzeitig sprechen („wer spricht wann“). Allerdings haben sich auch die Sprachsynthese oder Stimmwandlung dergestalt verbessert, dass die Sicherheit der Erkennung einer Person zunehmend sinkt, da die Stimme imitiert sein könnte.

Noch weniger bekannt hingegen sind die Fortschritte im Bereich der „Paralinguistik“ – also der Erkennung dessen was „sonst“ in der Sprache mitenthalten ist. Diese Information, die sowohl dem Klang der Stimme als auch der Wahl der Worte entnommen werden kann, beinhaltet eine erstaunlich reichhaltige Information über den Zustand und die Eigenschaften eines Sprechers. In den 1990ern lag das Interesse noch hauptsächlich auf der automatischen Erkennung der Sprecheremotion und dem Stresszustand eines Sprechers. In den letzten Jahren hat sich die Palette der automatisch erkennbaren Eigenschaften jedoch dramatisch erweitert.

Als Zustände eines Sprechers können etwa auch das Interesse, die Müdigkeit, Betrunkenheit, physische und kognitive Last, Aufrichtigkeit, der Adressat (wie Kinder, Verwandte oder Vorgesetzte) oder Zustände wie Essen (inklusive einer groben Einschätzung dessen, was gegessen wird) bis hin zur Herzfrequenz bis auf wenige Schläge pro Minute Abweichung genau automatisch aus der Stimme „erhört“ werden.

Bezüglich der persönlichen Eigenschaften inkludiert der Rahmen der Möglichkeiten das Geschlecht, Alter bis auf einige Jahre genau, die Körpergröße bis hin auf wenige Zentimeter genau, das Persönlichkeitsprofil wie anhand des Fünffaktorenmodells (Offenheit für Erfahrungen, Gewissenhaftigkeit, Extraversion, Verträglichkeit, Neurotizismus) der Gesundheitszustand (es können etwa Diagnosen einer einfachen Erkältung bis hin zu frühen richtungsweisenden Diagnosen bzgl. Alzheimer-, Autismus-, Biploar-, Parkinsons-, Rett- oder fragiles-X Syndrom, oder diverser Krebserkrankungen geleistet werden) oder der Muttersprache selbst wenn eine andere Sprache gesprochen wird und betreffend des Grads der Muttersprachlichkeit einer Fremdsprache oder auch Charisma und Führungsqualitäten geschätzt werden. Die Fachliteratur berichtet von einer Vielzahl weiterer Experimente die belegen, dass ein Computer zunehmend eine Person ähnlich wie ein Mensch einschätzen kann, wenn er diese zum ersten Mal hört – also etwa, wie wenn wir am Telefon eine neue Person hören und beginnen, uns ein Bild von dieser zu machen. Oft jedoch kann der Computer dies bereits schon über unsere Möglichkeiten hinaus, wie zum Beispiel Perzeptionsstudien zur menschlichen Leistung bei der Einschätzung der Blutalkoholkonzentration angetrunkener Sprecher zeigten.

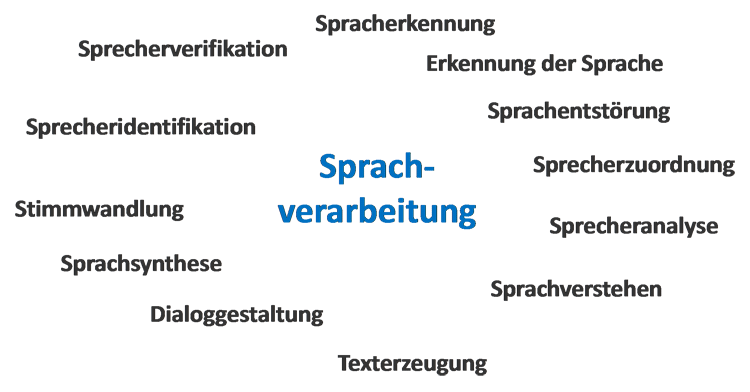

Moderne Sprachverarbeitung untergliedert sich in eine Reihe von Teilbereichen wie den gezeigten Kerndisziplinen, die zunehmend verzahnt werden, um ganzheitliche Sprachverarbeitung zu ermöglichen.

Potential im Bankenbereich

Voice Banking ist bereits Realität, aber welche Methoden bieten sich künftig an? Die eingangs erwähnten Sprachassistenten können nicht nur hinsichtlich natürlicherer Kommunikation erweitert werden, sondern werden zunehmend emotionale und soziale Kompetenz aufweisen. So können Dialogsysteme der nächsten Generation zum Beispiel um die automatische Profilierung von Kunden für die Anpassung des Dialogs oder Auswertung dieses erweitert werden.

Im Gegensatz zu menschlichen Gesprächspartnern besitzt der Computer ferner die Möglichkeit ungeteilter Aufmerksamkeit und bei Bedarf perfekter Anpassung ohne Ermüdung. Er kann darüber hinaus, wenn ihm die Möglichkeit geboten wird, vom Umgang mit Millionen Kunden lernen.

Stimmanalysen des Computers können erwartungsgemäß bedeutend höhere Präzision erreichen, als Menschen dies könnten. So kann ein automatischer Sprachassistent etwa akustische und sprachliche Verhaltensmuster bei der Synthese „seiner“ Stimme und Wahl seiner Worte perfekt auf Kunden abstimmen, um etwa sympathisch wahrgenommen zu werden. Er kann zeitlich exakt hören, wann die Aufmerksamkeit und das Interesse oder die Zuneigung des Kunden hoch sind, um etwa Produkte und Dienstleistungen günstig zu bewerben. Und er kann lernen, welche Kundengruppe am besten in welcher Weise zu bedienen ist – schritthaltend mit gesellschaftlichen Veränderungen und Trends und kulturübergreifend.

Wird Sprachverarbeitung Bankdienstleistungen verändern?

Man kann wohl mit hoher Sicherheit davon ausgehen, dass die zunehmende Leistungsfähigkeit und Möglichkeiten automatischer Sprachverarbeitung und ihrer Teildisziplinen wie im Bild dargestellt in Kombination mit weiterer künstlicher Intelligenz Voice Banking und in der Konsequenz die Kundenbetreuung als solches rasch und nachhaltig verändern werden. Dies liegt einerseits daran, dass Sprachassistenten aktuell bereits immer breiteren Einzug in unseren Alltag erfahren und die Interaktion und Kommunikation mit technischen Systemen in Zukunft im Allgemeinen wohl vermehrt mittels natürlicher Sprache erfolgen und erwartet werden wird. Andererseits bieten die geschilderten Möglichkeiten enormes Potential für weitgehend fehlerfreien, perfekt angepassten und stets verfügbaren Kundenservice, welcher gleichzeitig in noch unbekannter Weise ausgewertet und analysiert werden kann.

Ohne Zweifel müssen dabei vor allem Fragen der Kundensicherheit und -Privatsphäre sowie der generellen Ethik und rechtlichen Lage im Vorfeld, begleitend und nachhaltig priorisiert werden. Im Bereich der künstlichen Intelligenz stehen entsprechend allgemein zu Recht aktuell Fragen der Erklärbarkeit, Verantwortlichkeit und Verlässlichkeit entsprechender technischer Systeme im Fokus.