ChatGPT kennen die meisten und jeden Tag gibt es Hunderte neuer Anwendungen. Trotz der Möglichkeiten sind wir weit von einem flächendeckenden Einsatz entfernt. Wie können sich Unternehmen und Belegschaften auf eine Zukunft vorbereiten, die noch unbestimmt ist?

Überblick, Einblick und Ausblick zu den Perspektiven und Herausforderungen von Generativer Künstlicher Intelligenz, wie ChatGPT.

Es hat selten so große Aufmerksamkeit um die Einführung einer technischen Neuerung gegeben wie bei ChatGPT. Kein Wunder, dass nach dem Gartner Hype Cycle generative KI dem Zyklus der „überzogenen Erwartungen“ zugeordnet wird: Viele Anwendungen, große Zuversicht, dennoch keine Marktdurchdringung.

Deswegen besser erst einmal abwarten? Das sollte jedes Unternehmen für sich entscheiden, von welchen Chancen es partizipieren und welche Risiken es eingehen will. Oder um es mit der Erfinderin Jackie Fenn zu sagen: Bis wir eine Akzeptanz wie bei anderen Technologien erreichen, dürfte es noch ein paar Jahre dauern.

Der Reiz der generativen KI birgt gerade das Risiko

Die bisherigen Formen von KI wie Maschinelles Lernen oder Deep Learning können ziemlich perfekt Sachen zuordnen und verfügen über eine hohe Prognosequalität. Ziemlich perfekt ist die generative KI hinsichtlich ihrer Sprachqualität. Nur an der Fehlerlosigkeit des Inhalts hapert es manchmal noch.

Woran liegt das? Und warum sollte es bei der Verwendung im Hinterkopf behalten werden? Ein paar Ursachen seien hier aufgezeigt:

1. Mangelnde Transparenz der KI-Modelle

Anwender der KI wissen nicht, wie die einzelnen Modelle genau funktionieren, zum Beispiel wie und mit welchen Daten die KI trainiert worden ist. Deswegen gibt es keine Gewissheit, für welche Fachfragen ein Model geeignete Antworten erzeugen kann. Wie gravierend die Intransparenz bei den größten zehn Foundation Models ist, zeigte erst kürzlich eine von der Stanford University veröffentlichte Studie.

2. Zuordnung durch Wahrscheinlichkeiten nicht durch Fakten

Die Antworten klingen perfekt, doch sie sind komplett falsch. Die Maschine hat dennoch richtig funktioniert. Die Ausgabe wird erzeugt auf Basis von Korrelationen und Wahrscheinlichkeiten. Und wenn etwas wahrscheinlich ist, muss es nicht richtig sein.

3, Datenqualität und Datenhaushalt

Diese alte Informatiker-Phrase gilt gerade für die Datenfütterung der KI-Modelle. Wie wichtig es ist, die Algorithmen mit konsistenten und vollständigen Daten zu trainieren, zeigt das Beispiel der Halluzinationen. Stehen nur wenige oder gar keine Daten zur Verfügung, entstehen fiktive Antworten oder ganz ohne Bezug zur Anfrage bzw. Widersprüche im Text oder in Bezug auf die Anfrage. Für Kundenantworten ist das weniger geeignet.

Da die Trainingsdaten von Menschen geschaffen wurden, sind diese nicht wertefrei. Insofern kommt es zu Verzerrungen oder Bias. Ärzte werden bspw. meist mit weißer Hautfarbe dargestellt und Strafgefangene mit dunkler. So belegt eine Studie, dass Gesichtserkennungssoftware bei weißen Gesichtern grundsätzlich besser abschneiden als bei dunkleren. Daneben sind die Daten nicht generell vor Manipulationen geschützt. Gerade eine generative KI lernt aus der Interaktion. Durch geschickte Anweisungen kann eine „falsches“ Training erzeugt werden.

4. Informationsüberflutung und Desinformation

Wenn es immer einfacher wird, Inhalte mittels KI zu produzieren, ist mit einer deutlichen Zunahme von Amateurcontent zu rechnen. Problematisch wird es, wenn Desinformationskampagnen insbesondere aus politischen oder kriminellen Gründen überhandnehmen, sodass es insgesamt zu einem Vertrauensverlust in der Gesellschaft kommen könnte.

Weiterbildung ist mehr als ein Kurs über Prompting

Allein der kurze Einblick zeigt, dass es für das künftige Zusammenspiel Mensch und Maschine mehr bedarf, als ein paar Anweisungen in ein Eingabefeld zu tippen. Es erfordert verschiedenste Fähigkeiten:

- Eingabe -> Sozialkompetenz: Künftig übernimmt jeder Mitarbeiter mit KI-Verantwortung Aufgaben einer Führungskraft. Nämlich zu entscheiden, was delegiere ich, in welchem Umfang, mit einer präzisen Anforderung und wenn möglich in einem iterativen Vorgehen.

- Verarbeitung -> Technikkompetenz. Der Output ist von vielen Faktoren abhängig. Deswegen gilt es ein Verständnis für den Datenhaushalt, die typischen Fehlerursachen und damit zusammenhängende Vermeidungsstrategien zu erlangen.

- Ausgabe -> Fachkompetenz: KI ersetzt nicht das Fachwissen! Die Beurteilung der Qualität der KI kann nur erfolgen, wenn Ergebnisse nicht einfach „blind“ übernommen, sondern hinsichtlich Plausibilität und Anforderung überprüfen werden können. Also ist weiterhin lebenslanges Lernen angesagt.

KI benötigt somit Führung, wobei die Führung nicht von oben kommen muss und somit sich ebenso die Frage stellt, wie künftig Aufbauorganisationen zu gestalten sind.

Ist der Chatbot die Krönung der generativen KI?

Mittlerweile kann jeder eigene GPT-Bots ohne Programmierkenntnisse erstellen und diese sogar künftig in einen eigenen GPT-Store online stellen. Das bietet vielfältige Möglichkeiten, um Tätigkeiten auf die Maschine zu verlagern. Fraglich nur, ob das wirklich in allen Fällen die intelligenteste Prozesslösung ist. Ziel sollte es sein, dass der Kontakt – mithin das Kunden- oder Mitarbeiterproblem – erst gar nicht entsteht, um es lösen zu müssen. Die KI erstellt dazu im Hintergrund die Lösung, ohne dass Kunden oder Mitarbeiter danach fragen oder suchen müssen. Oder um es mit Marc Weiser zu sagen: „Die profundesten Technologien sind diejenigen, die verschwinden. Sie weben sich in den Alltag ein, bis sie von diesen nicht mehr zu unterscheiden sind.“

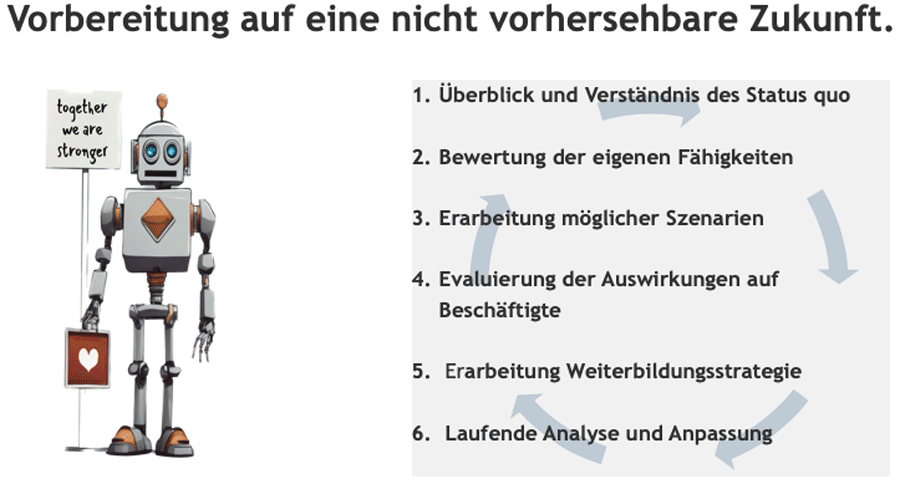

Einführung generativer KI im Unternehmen will gut durchdacht sein

In vielen Studien werden beeindruckende Produktivitätszuwächse genannt, die sich durch die Einführung von KI erzielen lassen. Je größer die Zahlen desto schwieriger sind die Fragen nach dem Weg dorthin. Beseitigt die Technik Arbeit oder verschiebt diese eher bestimmte Tätigkeiten von einem Aufgabenfeld in ein anderes? Steht die Automatisierung im Vordergrund oder die Innovation?

So hat der PC das Schreibbüro überflüssig gemacht. Nur die Tätigkeiten sind nicht weggefallen, sondern verlagert worden. Mithin ist der Einsatz von KI in eine gesamtheitliche strategische Planung mit abgeleiteten operativen Maßnahmen einzubetten. Ansonsten werden Effekte wie bei einer Studie mit rund 750 BCG Consultants produziert. Zwar konnten auf der einen Seite Leistungen deutlich verbessert werden, andere nahmen dagegen ab, weil zu sehr den Ergebnissen der KI vertraut wurde.

Strategie, um Unternehmen auf die Einführung von Künstlicher Intelligenz vorzubereiten.

KI wird künftiges Arbeiten und Leben verändern

KI ist eine der Technologien, die das künftige Arbeiten und Leben noch mehr verändern wird als das Internet. Der Weg dorthin wird Berg- und Talfahrten beinhalten. Gerade weil die Zukunft noch unbestimmt ist, sind strategische Planungen und die Förderung der Lernbereitschaft der Belegschaft essentiell für den Einsatz von KI im Unternehmen.

Basis für den Blogbeitrag war ein Vortrag beim Handelsblatt. Unterlagen und Quellenangaben stehen hier zum Download zur Verfügung.